## 질문

1. spike_train의 encode_stochastic 에서 normalize

전체 scale을 0~1로 Min-Max scaling 하면 되지않나. l2norm 으로 하는게 더 좋나?

2. classification 에서

f_spike 는 lateral inhibition 하는걸 카운트 하는거 같은데

왜 한번 spike 하고 난뒤 그뒤로는 실행이 안되도록 했을까.

- training

3. rl.py 에서 25번째줄 del_w < 0 일때 왜 w-abs(w_min) term을 곱하는지?

단순히 w_max, w_min 의 bounded 되어야 하는 거면 abs(w-w_min) 으로 해야할거 같은데.

이해한바로.

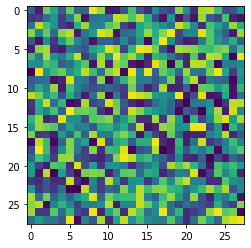

input neuron : input image - receptive field 이용 potential 변환(hidden layer)

hidden neuron : potential -> spike train으로 synapse to output neuron 전달.

output neuron : layer2 neuron.

lateral inhibition 와 stdp 로 학습.

단순히 lateral inhibition 한 winner neuron이 그 class neuron 되는거 같은데 당연한 느낌.

lateral inhibition 당한 뉴런은 어쩔수 없이 spike 나오기 어려워짐.

Uploaded by N2T

'Nengo' 카테고리의 다른 글

| nengo 하고싶은 것 (0) | 2022.06.14 |

|---|---|

| Nengo tutorial (0) | 2022.06.14 |

| 210714_nengo_2주차_hyperpolarization답변 (0) | 2022.06.14 |

| Hyperpolarization recovery (0) | 2022.06.14 |

| LIF neuron (0) | 2022.06.14 |